Wenn wir eine Größe oft gemessen haben, möchten wir statt allen Messwerten einfach einen typischen Wert angeben. Wie groß ist z.B. das typische Einkommen aller Österreicher? Oft wird dafür das arithmetische Mittel verwendet, das eigentlich der Schwerpunkt der Messwerte ist. (Wie weit Mittelwert und Median voneinander abweichen können, wird hier diskutiert.)

Die einzelnen Messwerte streuen mehr oder weniger weit um diesen Mittelwert. Ein Maß für die Streuung ist die Standardabweichung . Als typischer Bereich der Werte wird oft das Intervall

verwendet.

Aber wie viele Werte sind wirklich in diesem Bereich bzw. wie weit können die Messwerte überhaupt vom Mittelwert abweichen? Wie wir sehen werden, ist der Bereich, in dem garantiert mindestens die Hälfte der Messwerte liegt. Und typisch kann ja nur etwas sein, was zumindest für die Hälfte zutrifft. Darüber hinaus liegen sicher alle n Messwerte im Intervall

.

Arithmetisches Mittel und Standardabweichung

Für die n Messwerte ,

, …,

berechnen wir den Mittelwert

mit

Die Varianz ist die mittlere quadratische Abweichung vom Mittelwert

und die Standardabweichung ist die Wurzel aus der Varianz

Die Tschebyschow-Ungleichung

Durch das Quadrat sind alle Summanden in der Varianz positiv (oder 0); lassen wir einen Teil davon weg, kann die Summe daher nur kleiner werden. Deshalb gilt

weil wir jetzt nur die Messwerte nehmen, die mindestens a vom Mittelwert

abweichen (in beide Richtungen).

Es mag überraschen, dass die Summe der Abstandsquadrate kleiner wird, wenn wir die Werte nahe beim Mittelwert weglassen. Aber die Varianz ist eben die Summe über die Werte mit großem und kleinem Abstand.

Wenn ist, muss aber auch

sein, woraus

folgt. Die letzte Summe zählt einfach die Anzahl der Messwerte, die mindestens den Abstand a vom Mittelwert haben.

Dividieren wir die letzte Ungleichung noch durch , erhalten wir

Die linke Seite ist der Bruchteil der Messwerte, deren Abstand vom Mittelwert mindestens a beträgt. Und dieser Bruchteil nimmt mit zunehmendem Abstand a zumindest quadratisch ab. Das ist die Tschebyschow-Ungleichung für Messwerte.

Dabei sind die n Messwerte und ihre Varianz

fix. Was wir uns aussuchen können ist der Abstand a und daraus erhalten wir den maximalen Bruchteil der Messwerte mit Mindestabstand a zum Mittelwert; oder wir suchen uns umgekehrt den Bruchteil aus und erhalten den Abstand a.

Messen wir den Abstand in Standardabweichungen, , erhalten wir die Variante

für den Bruchteil, der mindestens k Standardabweichungen weit weg ist.

Für ergibt sich, dass alle Messwerte mindestens eine Standardabweichung abweichen können; mit

können nur maximal ein Viertel der Werte zwei Standardabweichungen oder mehr weg sein; und mit

folgt, dass nur ein Neuntel der Messwerte über drei Standardabweichungen vom Mittel weg sein kann.

Abschätzung des Bruchteils

Umgekehrt ist der Bruchteil b der Messwerte, die näher als k Standardabweichungen beim Mittelwert liegen, mindestens

Für wird die rechte Seite gleich 1/2. Egal welche Messung wir durchführen, mindestens die Hälfte der Messwerte liegt näher als

beim Mittelwert

. Ohne weiteres Wissen über den Ursprung der Messwerte können wir nichts Genaueres aussagen.

Wenn wir viele Werte aus einer Normalverteilung ziehen (s.u.), könnten wir sogar sagen, dass rund 2/3 der Werte innerhalb einer Standardabweichung um den Mittelwert liegen. Für diese viel schärfere Aussage benötigen wir aber zusätzliches Wissen.

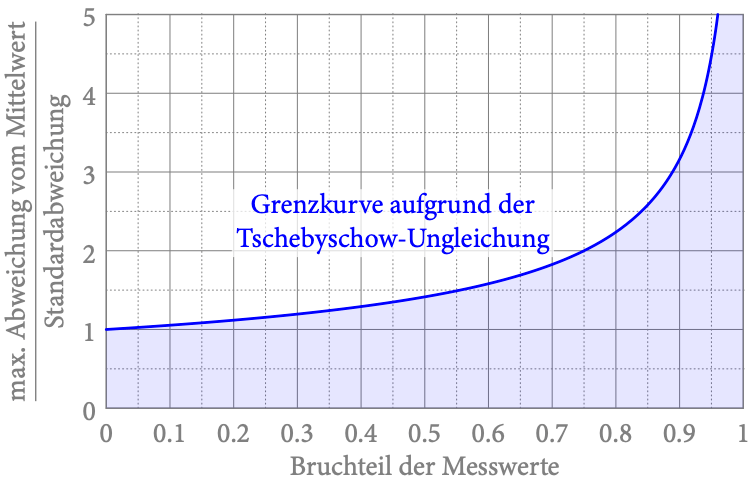

Interessant ist, wie viel Standardabweichungen k wir für einen vorgegebenen Bruchteil b maximal vom Mittelwert weg sein können. Formen wir die letzte Ungleichung auf k um, erhalten wir

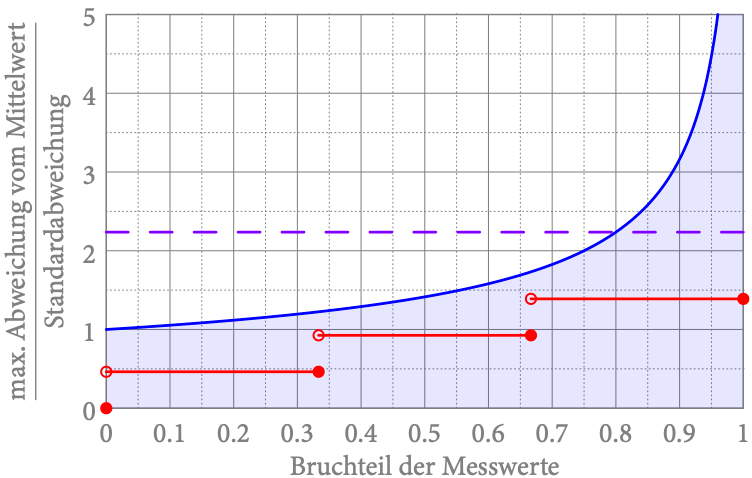

Abb. 1 zeigt das Resultat. Die blaue Kurve ist die maximale Abweichung aus der Tschebyschow-Ungleichung. Die Abweichungen beliebiger Messungen können nicht größer sein, wir sind also sicher irgendwo in der blau schattierten Fläche.

Die Hälfte der Messwerte haben maximal den Abstand , zwei Drittel maximal

und drei Viertel maximal

.

Beispiele

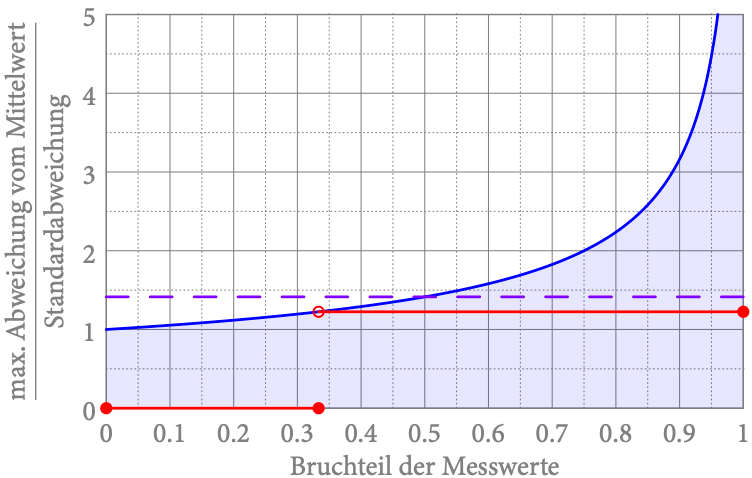

1. Nehmen wir zunächst an, wir haben die drei Werte -1, 0 und 1 gemessen. Offensichtlich ist und die Standardabweichung ist

Von den drei Zahlen ist eine gleich dem Mittelwert, hat also den Abstand 0. Die beiden anderen haben jeweils den Abstand 1, sind also weit weg.

Ein Drittel der Messwerte hat also maximalen Abstand 0, die zwei anderen Drittel haben maximalen Abstand . Diese Anteile sind durch die zwei Geradenstücke in Abb. 2 dargestellt. Prinzipiell kann man diese Geradenstücke auch als stückweise konstante Funktion auffassen. Solange der Bruchteil kleiner gleich 1/3 ist, ist die maximale Abweichung 0; wenn der Bruchteil größer als 1/3 ist, dann ist die maximale Abweichung

.

An Sprungstellen von einem Geradenstück zum nächsten, gehört der Punkt zum unteren Stück, ist am oberen daher mit einem offenen Kreis markiert. Wenn man viele Messwerte und Abstände zum Mittelwert hat, werden die Geradenstücke kürzer und die Endpunkte wandern aufeinander zu. Im Grenzfall von unendlich vielen Abständen werden aus den Geradenstücken einzelne Punkte, die auf einer Kurve liegen (s.u.).

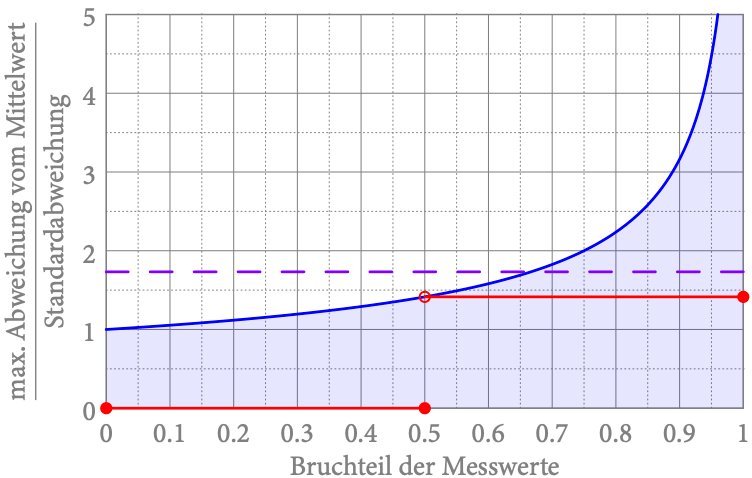

2. Nehmen wir an, wir hätten die vier Messwerte -1, 0, 0 und 1. Der Mittelwert ist wieder 0, und die Standardabweichung ist etwas kleiner. Hier hat die eine Hälfte der Messwerte maximal die Abweichung 0 und die andere Hälfte maximal die Abweichung

(s. Abb. 3).

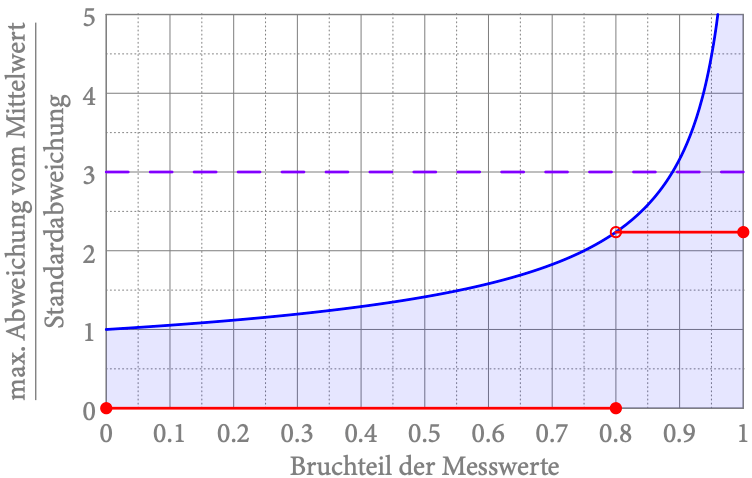

3. Die Messwerte -1, 8-mal die 0 und 1 legen den Sprung zu einem noch größeren Bruchteil der Messwerte. Der Mittelwert ist weiter 0, die Standardabweichung ist nun noch kleiner mit . Acht von zehn Werten haben daher die Abweichung 0 vom Mittelwert, und 2 jeweils den Abstand

(s. Abb. 4).

Die drei Beispiele haben gezeigt, dass Sprünge an die Grenze der Tschebyschow-Ungleichung herankommen können – es also keine allgemein gültige, schärfere Abschätzung geben kann. Mit vielen Werten nahe des Mittelwerts und ein paar weiter weg können diese Sprünge bei jedem beliebig großen Bruchteil der Messwerte auftreten.

4. Als letztes Beispiel nehmen wir die sechs Messwerte -3,-2, -1, 1, 2 und 3. Der Mittelwert ist wieder 0, und die Standardabweichung ist diesmal . Ein Drittel der Messwerte weicht maximal

vom Mittelwert ab, ein weiteres Drittel um

und das letzte Drittel um maximal

(s. Abb. 5). Hier haben wir also mehrere Sprünge, von denen keiner an die Grenzkurve herankommt.

Verschiebungen und Skalierungen

Wenn wir zu allen Messwerten dieselbe Zahl addieren, verschiebt sich auch der Mittelwert um diese Zahl, weil sie in jedem Summanden drinsteckt. Daher ändern sich die Abstände zum Mittelwert dadurch gar nicht.

Würden wir statt der Messwerte -1, 0, 0 und 1 in Abb. 3 z.B. die Werte 5, 6, 6 und 7 nehmen, würde sich an Abb. 3 genau nichts ändern.

Ähnlich ist es, wenn wir alle Werte mit derselben Zahl (> 0) multiplizieren. Dieser Faktor steckt in allen Werten, kann daher aus der Summe für den Mittelwert herausgehoben werden, und multipliziert daher ebenfalls den Mittelwert. In der Standardabweichung kann man das Quadrat dieses Faktors aus der Summe herausheben, durch die Wurzel wird es aber wieder derselbe Faktor. Die Abstände werden jetzt zwar mitskaliert, aber wenn wir sie in Einheiten der Standardabweichung messen, ändert sich wieder nichts.

Würden wir die Werte hinter Abb. 3 mit 2 multiplizieren, hätten wir -2, 0, 0 und 2. Die Standardabweichung ist jetzt aber auch auf verdoppelt, wodurch sich an Abb. 3 wieder nichts ändern würde.

Wir können also beliebige Messwerte standardisieren, indem wir ihren Mittelwert subtrahieren und durch ihre Standardabweichung dividieren. Dann erhalten wir neue Werte mit Mittelwert 0 und Standardabweichung 1, der Vergleich mit der Tschebyschow-Ungleichung bleibt dabei unverändert.

Normalverteilung

Wie wir oben schon erwähnt haben, gilt die Tschebyschow-Ungleichung für beliebige Mengen von Messwerten. Wenn wir aber etwas mehr wissen, woher unsere Messwerte kommen, können wir die Grenzen meistens kleiner machen.

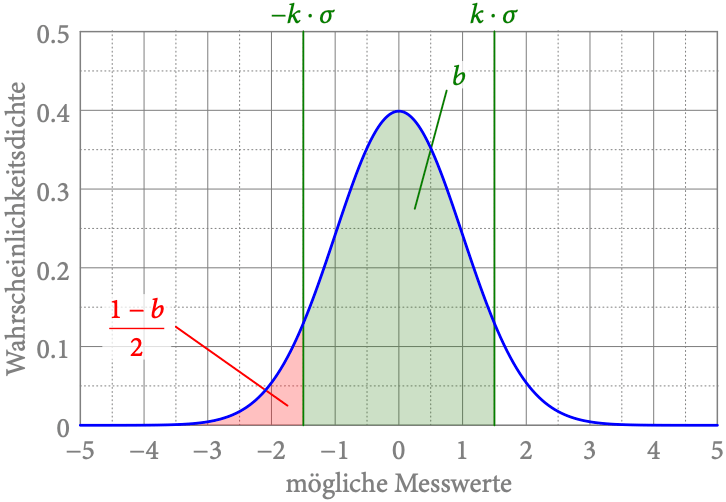

Eine stetige Zufallsvariable beschreibt im Wesentlichen das Verhalten von überabzählbar unendlich vielen Messwerten, speziell bezüglich Lage und Streuung. Die wichtigste dieser Verteilungen ist die Normalverteilung, deren Wahrscheinlichkeitsdichte in Abb. 6 gezeigt ist.

Wenn wir viele Zufallszahlen aus so einer Verteilung ziehen, dann kommen mehr Werte aus den Bereichen, wo die Wahrscheinlichkeitsdichte groß ist.

Weil wir jetzt tatsächlich unsere Wahrscheinlichkeitsdichte kennen, können wir sofort die maximale Abweichung für den Bruchteil b berechnen. In Abb. 6 ist die grün schattierte Fläche jener Bruchteil b der Messwerte, die maximal in beide Richtungen abweichen. (Für eine Verteilung übernimmt

die Rolle von

.)

Eine für alle stetigen Verteilungen definierte Funktion ist die kummulative Verteilung , die den Flächeninhalt unter der Dichte von

bis x berechnet. Aufgrund der Symmetrie unserer Dichte ist dieser rote Flächeninhalt gleich

. Damit haben wir die Gleichung

Mithilfe der Umkehrfunktion können wir nach

auflösen, wobei für die Standardnormalverteilung ist. In R wird die rechte Seite mittels des Befehls

-qnorm((1.0 - b)/2.0)

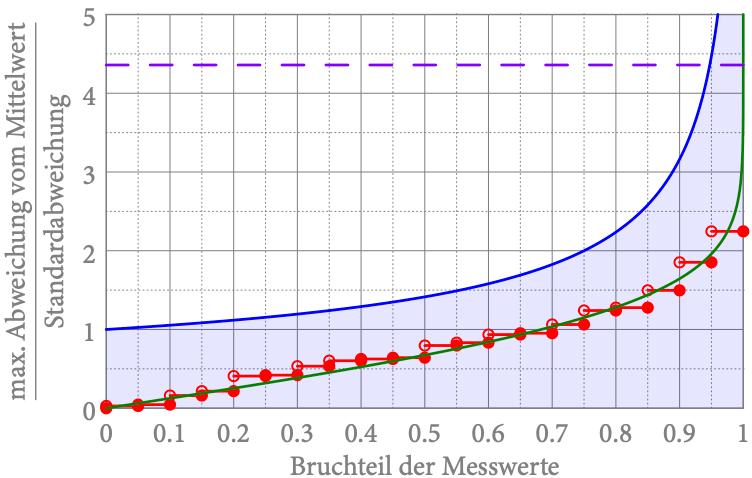

berechnet. Damit ergibt sich die grüne Kurve in Abb. 7, die wir mit

b <- seq(0.0, 2.0*pnorm(5.0) - 1.0,

length.out = 500)

k <- -qnorm((1.0 - b)/2.0)

plot(b, k, type = "l",

col = "darkgreen", lwd = 2)

zeichnen lassen können. Dabei ist 5.0 der Maximalwert für k.

Unser Wissen über die Normalverteilung ermöglicht jetzt engere Grenzen. Für 50% der Messwerte ist die maximale Abweichung vom Mittel statt

; für zwei Drittel der Werte

statt

; und für drei Viertel der Werte

statt

. Erst, wenn wir praktisch alle Messwerte erfassen wollen, müssen wir zu beliebig großen Abweichungen gehen.

Wenn wir eine endliche Menge an Zufallszahlen aus einer stetigen Verteilung ziehen, kann diese Stichprobe nicht exakt der Verteilung von überabzählbar unendlich vielen Werten entsprechen. Sie wird aber meistens in der »Nähe« liegen.

Ziehen wir z.B. 20 Werte aus einer Standardnormalverteilung, könnte sich Abb. 8 ergeben. Die Intervalle der Bruchteile sind zwar in der Nähe der grünen Normalverteilungskurve, liegen aber nicht ganz darauf.

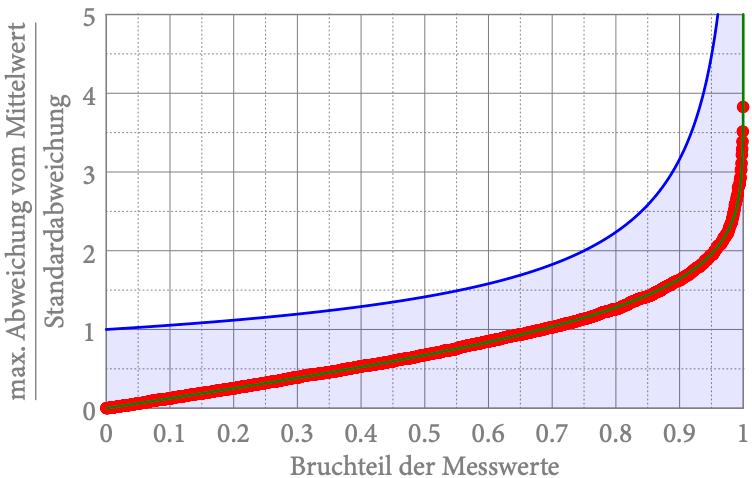

Wenn wir den Umfang der Stichprobe auf z.B. 2000 Werte erhöhen, erhalten wir Abb. 9. Die Geradenstücke sind jetzt kürzer als die Durchmesser der Punkte, wodurch sich praktische eine durchgehende Kurve ergibt. Diese folgt fast, aber noch nicht exakt der grünen Normalverteilungskurve.

Für andere Verteilungen ergeben sich jeweils unterschiedliche Grenzkurven.

Die Samuelson-Ungleichung

Die Idee, dass wir durch Weglassen nicht-negativer Summanden eine Summe nur kleiner machen können, führt noch zu einer weiteren Abschätzung.

Wenn irgendeiner der Messwerte

ist, gilt nämlich

Ziehen wir die Wurzel, erhalten wir links den Betrag, weil auch negativ werden könnte:

Weil ein völlig beliebig Messwert war, kann keiner der Messwerte weiter als

Standardabweichung vom Mittelwert weg sein.

Wie Paul Samuelson in den 1960ern herausfand (und andere schon davor …), lässt sich diese Schranke noch ein bisschen reduzieren. Die längliche Herleitung dazu habe ich in den Anhang verschoben. Die Samuelson-Ungleichung lautet jedenfalls

Alle, also 100% der Messwerte, weichen maximal Standardabweichungen vom arithmetischen Mittel ab. In den Abbildungen 2 bis 5 und 8 ist diese Schranke jeweils als strichlierte Linie eingezeichnet.

Eine schärfere allgemeine Abschätzung als die Samuelson-Ungleichung kann es nicht geben, weil ihr Minimum z.B. für die Messwerte -1 und 1 angenommen wird. Der Mittelwert ist 0, die Standardabweichung und es ist auch

.

Tschebyschow gegen Samuelson

Die Tschebyschow-Ungleichung besagt, wenn der Bruchteil der Messwerte gegen 1 geht, muss der Maximalabstand zum Mittelwert gegen Unendlich gehen. Und es gibt keine bessere allgemeine Abschätzung. Die Samuelson-Ungleichung hingegen besagt, dass alle Messwerte – also der Bruchteil 1 – maximal abweicht. Widerspricht sich das nicht?

Wie wir oben gesehen haben, brauchen wir für eine große Abweichung nahe dem Bruchteil 1 viele Werte, die nahe beim Mittelwert liegen, um die Standardabweichung klein zu halten, und ein paar, die weiter weg liegen. Insgesamt geht also auch die Anzahl n der Messwerte gegen Unendlich, wodurch sich der Widerspruch auflöst.

Besonders interessant ist die Samuelson-Ungleichung für kleine Mengen. Nehmen wir z.B. eine Gruppe von 5 Personen, deren Durchschnittsgröße 1.80 m sein möge, mit einer Standardabweichung von 5 cm. Dann kann die größte Person maximal 1.90 m groß und die kleinste maximal 1.70 m klein gewesen sein ().

Diskussion

Tschebyschow- und Samuelson-Ungleichung geben überraschende Antworten, wie weit Messwerte um den Mittelwert streuen können. Beide messen die Abweichungen in Standardabweichungen und folgen aus unserer Definition der Standardabweichung. Eine andere Definition würde andere Grenzen ergeben.

Wir haben zwar die ganze Zeit von Messwerten gesprochen, aber weder Tschebyschow noch Samuelson haben irgendein Geheimwissen über den Messprozess. Tatsächlich geht es einfach nur um Zahlenfolgen und ihre Eigenschaften. Ob wir die Zahlen erfunden, am Schwarzmarkt gekauft oder tatsächlich gemessen haben, spielt keine Rolle.

Außerdem können wir uns noch fragen, »Wie weit kann der Median vom Mittelwert abweichen?«.

Anhang: Herleitung der Samuelson-Ungleichung

Dazu definieren wir zuerst den Mittelwert aller Werte außer

:

(es ist ja ein Wert weniger).

Dieses können wir in die Varianz hinein schummeln:

wobei wir in der letzten Zeile eine binomische Formel verwendet haben. Diese lange Summe können wir in mehrere Summen aufspalten, wobei alles ohne i im Index eine Konstante ist:

Der letzte Summand ergibt sich, weil wir n-mal die Konstante addiert haben. Mit der Definition des Mittelwerts und weil

eine Konstante ist, folgt

Setzen wir das in die Varianz ein, erhalten wir

wobei in der letzten Zeile den Summanden mit aus der Summe genommen haben.

Jetzt kommt unsere Definition von ins Spiel: Es gilt nämlich

und deshalb auch

und

woraus

folgt.

Eingesetzt in die Varianz, ergibt sich

und damit die Behauptung. Die Reduktion des Faktors von auf

ist zugegeben etwas mühsam.