Zwischendurch ein kleine Abschweifung in die geometrische Optik, die für Rasterung/Schattierung und Raytracing gleichermaßen zutrifft.

In Teil 0 haben wir die (inverse) Lochkamera besprochen und wie man damit perspektivische Abbildungen erzeugen kann. Wir sehen die Welt aber mit unseren Augen, die keine Lochkameras sind, sondern eine Linse haben. Ebenso haben (Film-)Kameras mehr oder weniger aufwendige Linsensysteme. Warum funktioniert unser Lochkameramodell dann so gut?

Sphärische Konvexlinsen

Die Bilderzeugung optischer Systeme lässt sich oft durch die Abbildung mit einer dicken Konvexlinse ersetzen. Um es uns etwas einfacher zu machen, werden wir im Folgenden allerdings nur dünne, symmetrische Konvexlinsen besprechen.

Diese Linsen sind normalerweise aus durchsichtigem Material mit einem Brechungsindex n > 1 (Luft hat n = 1), sind in der Mitte dick und werden zum Rand hin immer dünner. Der Querschnitt so einer Linse ist in Abb. 1 hellblau schattiert. Die Randflächen sind meistens kugelförmig – weil das am leichtesten herzustellen ist, nicht weil es so toll ist. Man spricht dann von sphärischen Linsen.

Eine symmetrische Linse ist spiegelsymmetrisch zu einer Ebene durch ihre Mitte – die sogenannte Hauptebene.

Wieso können wir mit so einer Linse Dinge abbilden?

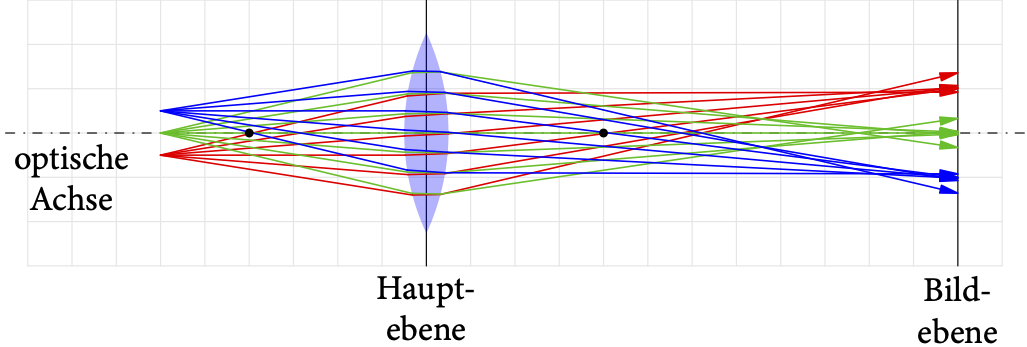

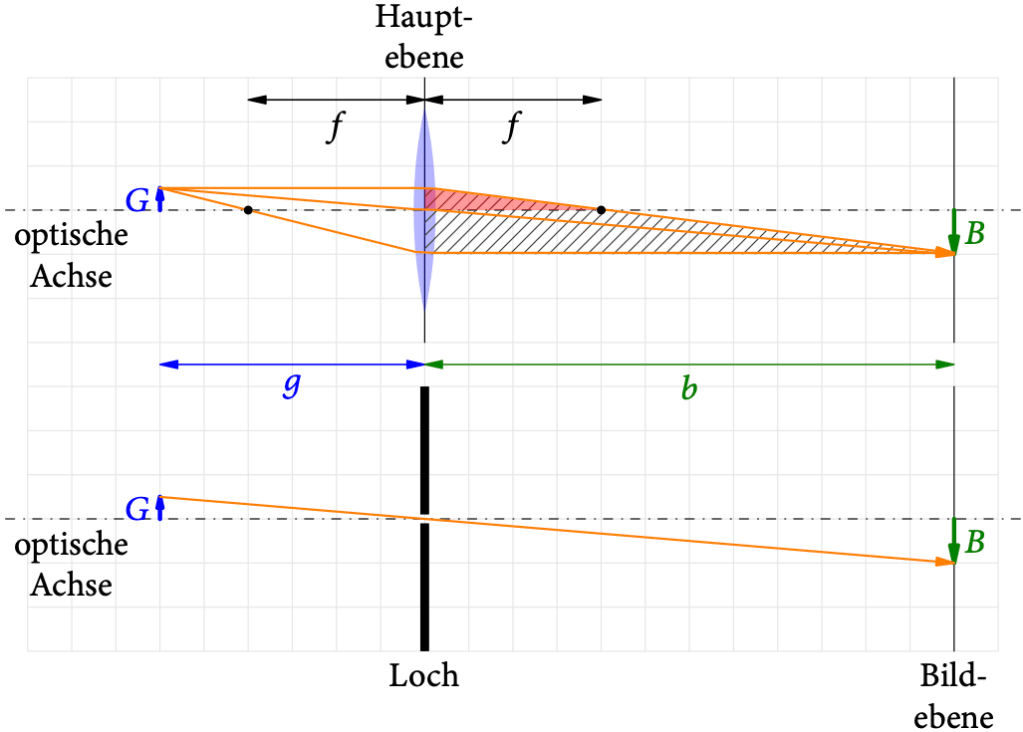

In Abb. 1 haben wir links von der Linse 3 Punkte, die Licht in alle möglichen Richtungen ausstrahlen. Entweder weil dort tatsächlich Lichtquellen sind oder weil das Punkte einer Oberfläche sind, die Licht anderer Quellen reflektieren.

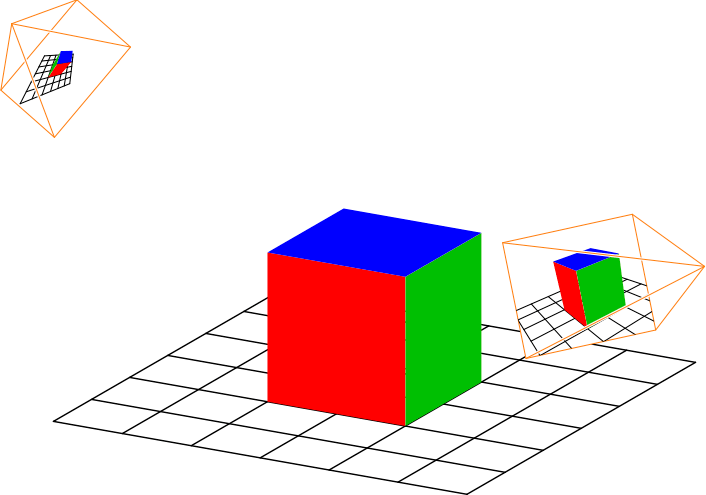

Verfolgen wir die Lichtstrahlen von einem Punkt durch die Linse, müssen wir zweimal das Brechungsgesetz anwenden. Das ergibt zunächst ein ziemliches Gewirr aus Strahlen. Interessanterweise stellen wir aber Folgendes fest: Strahlen, die von einem Punkt in verschiedene Richtungen abgestrahlt wurden, kommen rechts von der Linse fast wieder zu einem Punkt zusammen.

Für verschiedene Punkte in einer Ebene parallel zur Hauptebene passiert das wieder in einer Ebene parallel zur Hauptebene auf der anderen Seite (in der Bildebene). Allerdings steht das Bild auf dem Kopf: der rote Punkt unterhalb der optischen Achse wird oberhalb abgebildet; für den blauen Punkt ist es genau umgekehrt.

Hinter der Bildebene würden die Strahlen wieder auseinander laufen. Für ein scharfes Bild der Punkte müssen wir einen Film oder einen Bildsensor im Abstand der Bildebene anbringen.

Bei sphärischen Linsen kommen allerdings nicht alle Strahlen zu einem Punkt zusammen. Wenn wir genauer schauen, sehen wir, dass Strahlen vom Rand der Linse am stärksten abweichen (sphärische Aberration).

Paraxiale Näherung

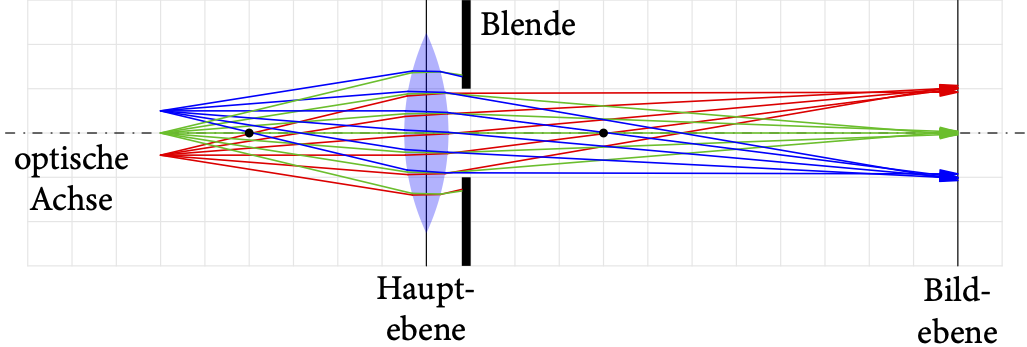

Blenden wir die Strahlen am Rand der Linse aus, arbeiten wir nur mit Strahlen, die nahe der optischen Achse durch die Linse gehen (paraxiale Näherung). Wie Abb. 2 zeigt, haben wir dadurch die Abbildung unserer Punkte stark verbessert (auf Kosten der Helligkeit). Wirklich exakt wird es für sphärische Linsen nie.

BTW: Die Blende in Abb. 2 hat den Durchmesser 2 LE, was der halben Brennweite entspricht. Die Blendenzahl ist hier daher 2.0 und wir haben eine f/2.0-Blende.

Brennpunkt

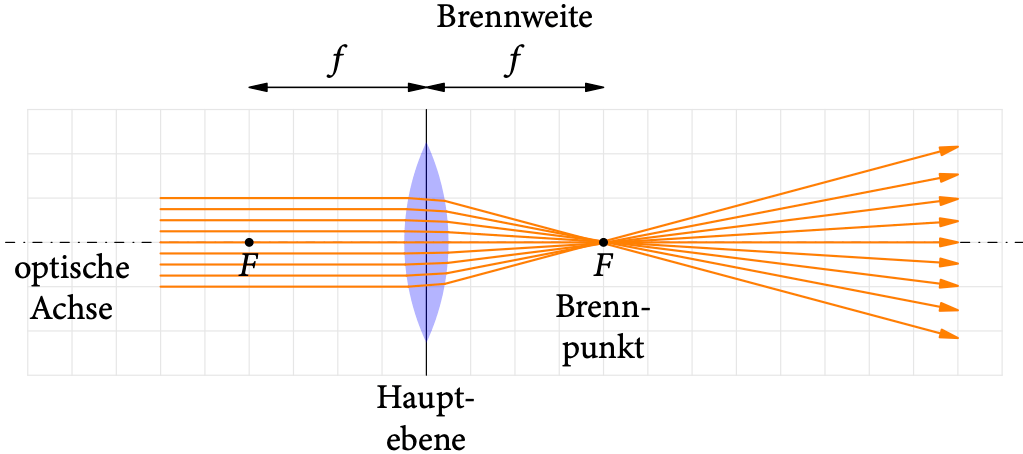

Wenn Licht parallel zur optischen Achse einfällt, wird es von unserer Linse in Richtung Brennpunkt F gelenkt bzw. »im Brennpunkt gesammelt« (s. Abb. 3). Daher auch der Name Sammellinse für Konvexlinsen. Wirklich gut funktioniert das wieder nur in der paraxialen Näherung.

Der Abstand der Brennpunkte zur Hauptebene ist die Brennweite f. Für asymmetrische Linsen können die Brennweiten links und rechts von der Linse unterschiedlich sein.

Wenn sich im Brennpunkt nichts befindet, was das Licht absorbieren könnte – z.B. ein Sensor –, laufen die Strahlen danach wieder auseinander. Für nachfolgende optische Systeme schaut es dann so aus, als hätte man eine Punktlichtquelle im Brennpunkt F.

Dünne Linsen

Paraxiale Strahlen, die auf der einen Seite der Linse parallel zur optischen Achse einfallen, gehen also auf der anderen Seite durch den Brennpunkt. Aufgrund der Umkehrbarkeit des Strahlengangs gilt das auch umgekehrt: Aus Strahlen durch den Brennpunkt links werden rechts Strahlen parallel zur optischen Achse.

Aus einem Parallelstrahl wird ein Brennpunktstrahl und aus einem Brennpunktstrahl wird ein Parallelstrahl.

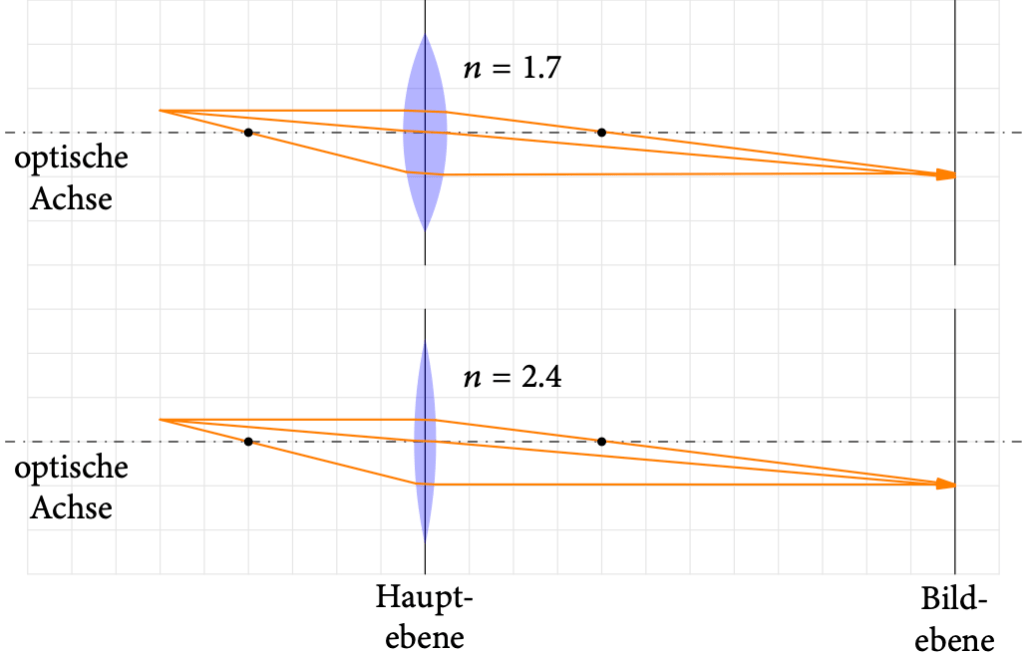

Abb. 4 (oben) zeigt das für unsere schon bekannte Linse. Ganz exakt stimmt es nicht, aber näherungsweise schon. Wenn wir Material mit einem höheren Brechungsindex verwenden, können wir bei gleichem Durchmesser und gleicher Brennweite die Dicke der Linse reduzieren (s. Abb. 4 unten); in unserem Fall von 1 LE auf 0.5 LE. Für diese dünnere Linse passt die Sache schon viel besser.

Neben den Parallel- und Brennpunktstrahlen ist in Abb. 4 noch ein weiterer interessanter Strahl gezeichnet:

der Mittelpunktstrahl verläuft fast ungebrochen durch die Mitte der Linse.

Je dünner eine Linse ist, desto näher sind die beiden brechenden Flächen an der Hauptebene. Für sehr dünne Linsen können wir also so tun, als ob es statt zweier Brechungen nur eine an der Hauptebene gibt.

Im Fall dünner Linsen können wir unser Bild immer mit zwei von diesen drei einfach zu zeichnenden Strahlen konstruieren. Auch wenn ein Teil der Linse verdeckt ist, sodass nicht alle drei Strahlen tatsächlich zum Bild kommen. Die Näherung der dünnen Linse (die zweite Näherung nach den paraxialen Strahlen) macht die Bildkonstruktion/-berechnung viel einfacher.

Stellt sich nur noch die Frage, wann ist eine Linse eigentlich »dünn«? Im Wesentlichen dann, wenn ihre Dicke viel kleiner als ihre Brennweite ist.

Die folgenden YouTube-Vides von John P. Hess (Filmmaker IQ) demonstrieren das oben Gesagte sehr schön, speziell auch in Hinsicht Fotografie und Film:

- The History and Science of Lenses

- The Properties of Camera Lenses

- Focusing on Depth of Field and Lens Equivalents

- The Science of Deep Focus and the Hyperfocal Distance

Dünne Linsen und Lochkameras

Wie vergleichbar ist die Bildentstehung dünner Linsen mit einer Lochkamera? Wo sind die Unterschiede? Abb. 5 zeigt einen Vergleich der Strahlengänge. Während die Linse viele Lichtstrahlen im selben Bildpunkt zusammenführen kann, ist es bei der Lochkamera immer nur einer. Dieser Strahl ist aber derselbe wie der Mittelpunktstrahl bei der Linse.

Wenn man also das Loch der Lochkamera an Stelle der Hauptebene platziert, ergibt sich bei gleicher Gegenstands- und Bildweite geometrisch dieselbe Bildgröße. Das Bild ist allerdings viel dunkler als mit einer Linse. Die Vergrößerung ist aber bei beiden gleich

,

wobei G, B die Gegenstands- bzw. Bildgröße sind und g, b die Gegenstands- bzw. Bildweite.

Bei der Lochkamera können wir den Schirm (die Bildebene) beliebig vor/zurück schieben und bekommen immer ein scharfes Bild. Bei der Linse geht das nicht so einfach.

Die Linsengleichung

Die Bildkonstruktion bei der Linse beinhaltet immer einen Brennpunktstrahl. Wir können Gegenstands- und Bildweite g und b hier nicht unabhängig voneinander wählen, weil auch die Brennweite f mitspielt.

In der Näherung der dünnen Linse ist der schraffierte Bereich in Abb. 5 ein rechtwinkeliges Dreieck, von dem das rot schattierte rechtwinkelige Dreieck ein Teil ist. Weil die Seiten dieser Dreiecke zueinander parallel sind, sind es ähnliche Dreiecke. Mit dem Strahlensatz erhalten wir dann

.

Dividieren wir durch G und setzen die Vergrößerung ein, erhalten wir

.

Wenn wir auch noch den letzten Doppelbruch vereinfachen, erhalten wir die Linsengleichung für dünne Linsen

.

Für ein scharfes Bild mit der Linse muss diese Gleichung erfüllt sein. Wobei man sagen muss, dass es immer einen ganzen Bereich gibt, der »akzeptabel« scharf abgebildet wird. Siehe auch das 3. Video von John Hess zur Schärfentiefe (depth of field).

Eine dünne Linse durch eine Lochkamera ersetzen

Bei einer Linse hängt die Lage der Bildebene offensichtlich vom Abstand des Gegenstands zur Linse ab. Bei einer Lochkamera sind die beiden jedoch (geometrisch) unabhängig. Welche Bildweite sollen wir also für dieselbe Vergrößerung einstellen?

Formen wir die Linsengleichung etwas um, erhalten wir

.

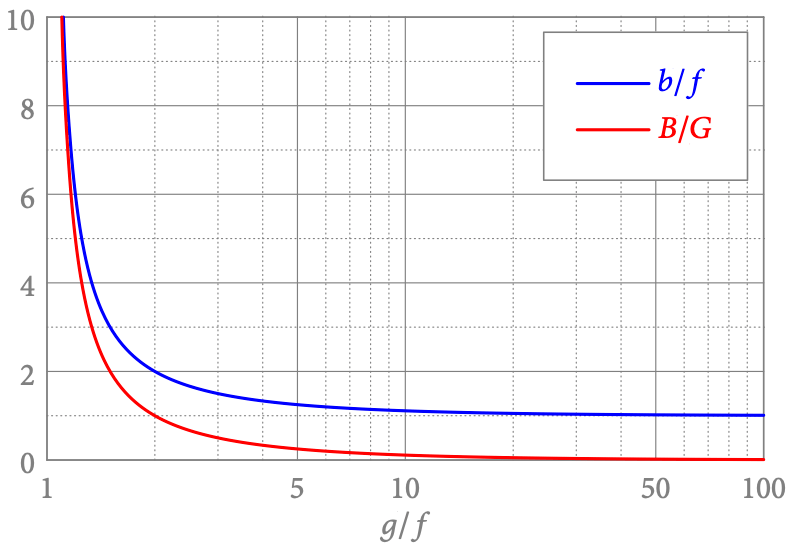

Dabei ist g/f bzw. b/f die auf die Brennweite f bezogene relative Gegenstands- bzw. Bildweite, die als blaue Kurve in Abb. 6 gezeigt ist. (Die Division durch f erfolgt, damit wir nicht für alle möglichen Brennweiten ein Diagramm wie in Abb. 6 zeichnen müssen.) Wenn der Gegenstand mehr als 10 Brennweiten von der Linse entfernt ist, können wir für unsere Lochkamera als Bildweite praktisch die Brennweite der Linse nehmen.

Wie sieht das mit realistischen Brennweiten aus? Das Auge z.B. hat eine Brennweite von etwa f = 20 mm. Für alles was weiter als 200 mm bzw. 20 cm entfernt ist, können wir b einfach gleich f setzen. Für eine 50 mm-Linse ginge das für alles, was mindestens 50 cm entfernt ist.

Schwieriger wird es, falls der Gegenstand näher an der Linse ist. Wie Abb. 6 zeigt, nimmt die Bildweite für eine Gegenstandsweite unter 10f zu. Für g = 2f ist auch b = 2f und die Vergrößerung ist gleich 1. Für noch kleinere Gegenstandsweiten muss die Bildweite stark erhöht werden. Um dieselbe Vergrößerung zu erreichen, müssten wir hier die Bildweite der Lochkamera immer der gewünschten Gegenstandsweite anpassen.

Falls der Gegenstand weniger als eine Brennweite von der Hauptebene entfernt ist, funktioniert unsere Linse als Lupe.

Ein paar Gedanken zum Clipping

Obige Überlegungen haben auch Auswirkungen auf die in Teil RS2 versprochene Diskussion zum Clipping. Wir haben Punkte/Linien abgeschnitten, wenn sie bzw. Teile von ihnen hinter der Schirmebene unserer Standardkamera bei z = -1 lagen. Aber warum? Das Loch, das der Hauptebene einer Linse entspricht, liegt doch bei z = 0 (s. Teil RS1)?

Die inverse Lochkamera als »reale« Kamera

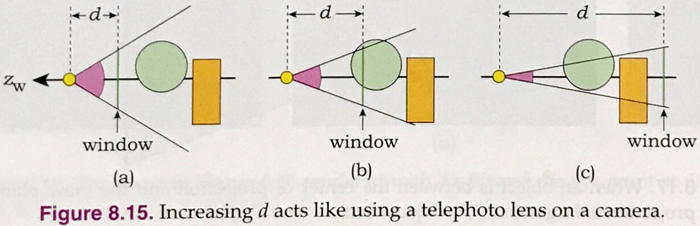

Eine Sichtweise – und ich schließe mich hier an – ist, dass die Schirmebene tatsächlich der vorderste Teil unserer Kamera ist (s. Abb. 7). Alles dahinter sollte daher nicht abgebildet werden. Es ist aus Sicht der Standardkamera bei z = -1 abzuschneiden.

In diesem Zusammenhang werden oft auch numerische Gründe angeführt, warum es günstig ist, an der near plane abzuschneiden. Auch wenn ich diese Gründe nicht von der Hand weise, sind sie rein mathematisch/physikalisch irrelevant.

Die inverse Lochkamera als »normale« Lochkamera

Es gibt aber auch eine andere Sichtweise: die inverse Lochkamera ist einfach eine normale Lochkamera mit aufrechtem Bild. Dann ist das vordere Ende das Loch – also der Augpunkt (eye point) – selber.

Z.B. findet sich im Buch Ray Tracing from the Ground Up von K. Suffern die Figure 8.15 (s. Abb. 8). Suffern hat offenbar kein Problem damit, den Schirm (bei ihm »window« genannt) hinter und sogar in die Objekte hinein zu legen. Die im Buch folgende Figure 8.16 zeigt die entsprechenden Szenen, wobei die Kugel immer im Vordergrund ist. In der Diskussion zu Figure 8.17 spricht er es auch deutlich aus: Wenn das Objekt zwischen Augpunkt und Schirm ist, wird es vergrößert abgebildet.

In dieser Interpretation müssten wir aus Sicht der Standardkamera bei z = 0 abschneiden.

Ist der Unterschied relevant?

In der ersten Sichtweise können wir mit der Schirmebene nur bis exakt an den Gegenstand heranfahren. Für eine simulierte Linse wäre dann bei b = g = 2f Schluss. Ein näher liegender Gegenstand könnte nicht mehr abgebildet werden, weil der Schirm dann bereits im Gegenstand liegen würde.

In der zweiten Sichtweise könnten wir bis g = f an den Gegenstand heranfahren, bevor wir auf eine Lupe umschalten müssten. Die sehr große Bildweite wäre hier weniger ein Problem.

Für ein simuliertes Auge ist der Unterschied also, ob wir bis 40 mm oder bis 20 mm herankommen können. Für die meisten Spiele – speziell Flugsimulatoren – ist der Unterschied praktisch egal. Für eine korrekte Simulation einer Linsenabbildung z.B. im Rahmen von Augmented Reality ist es komplizierter.

Diskussion

Wir haben jetzt zwar über die Einstellung der Bildweite geredet, unsere Standardkamera hat bisher aber eine fixe Bildweite von 1 LE. Wie wir das und auch ihre Position und Blickrichtung ändern können, werden wir erst in einem der nächsten Teile sehen. Davor müssen wir uns noch über (affine) Transformationen unterhalten.

Neben der sphärischen Aberration haben Linsen noch andere Probleme. Insbesondere wird Licht unterschiedlicher Farben nicht exakt gleich gebrochen. Linsensysteme von Kameras sind auch deshalb so aufwendig, weil mit mehreren Linsen aus verschiedenen Materialien versucht wird, die Abbildungsfehler des Gesamtsystems so klein wie möglich zu machen.

Die Radien der Linsen in den Abb. 1 bis 5 habe ich mit der Linsenmacher-Gleichung berechnet. Für symmetrische, sphärische Linsen lautet sie

,

wobei n der Brechungsindex, f die Brennweite und d die Dicke der Linse sind. Aus dieser quadratischen Gleichung in 1/R lässt sich dann der Kugelradius R ausrechnen. Weil sein muss, ist klar, welche der zwei Lösungen die richtige ist.

Sie sind immer noch unser Lieblingsmathe Fessa! :)

Liebe Grüße

~Hiermann, Burger